SEO-Optimierung der Facettennavigation für Online-Shops

Facettennavigation, also die Möglichkeit in Online-Shops nach Eigenschaften wie Preis, Farbe oder Marke zu filtern, verbessert die Nutzererfahrung – birgt aber erhebliche SEO-Risiken. Unsachgemäß umgesetzt, entstehen massenhaft URLs mit ähnlichem Inhalt, die Suchmaschinen-Crawler in eine Endlosschleife schicken können. Die Folgen: Verschwendung des Crawl-Budgets, doppelte Inhalte, verwässerte interne Verlinkung und technische Komplexität bei der URL-Verwaltung. In diesem Artikel analysieren wir die größten SEO-Probleme der Facettennavigation und zeigen strategische Lösungen auf – inklusive moderner Techniken wie robots.txt, Canonical Tags, Noindex, Google Search Console-Parametersteuerung sowie AJAX/JavaScript-Lösungen. Code-Beispiele (fehlerhaft vs. optimiert) veranschaulichen typische Fehler und Best Practices. Außerdem betrachten wir Shop-spezifische Hinweise (für Magento, Shopify, WooCommerce), um praxisnahe Empfehlungen für Shops mit umfangreichen Filteroptionen zu geben.

Typische SEO-Probleme der Facettennavigation

Crawling- & Indexierungsprobleme (Crawl-Budget)

Suchmaschinen behandeln jede einzigartige URL separat. Bei facettierten Filtern führt dies häufig zu Index Bloat – einer Aufblähung des Index mit unzähligen Varianten, die keinen eigenen Suchwert haben. Google-Bots versuchen erst durch Crawling herauszufinden, ob eine URL nützlich ist; Facetten mit URL-Parametern erzeugen jedoch praktisch unendliche URL-Räume, die den Crawler in Beschlag nehmen. Das Ergebnis ist Overcrawling: Crawler verschwenden Zeit auf unnötigen Filterseiten, während wichtige Seiten zu kurz kommen. Google bestätigt, dass solche duplizierten Facetten-URLs das Crawl-Budget verschwenden und die Server unnötig belasten. Sichtbar wird dieses Problem z.B. durch eine Diskrepanz zwischen tatsächlicher Seitenanzahl und den in der Suche gelisteten Seiten (Anzeichen für Index-Bloat). Im Worst Case verzögert dies die Indexierung neuer Inhalte erheblich.

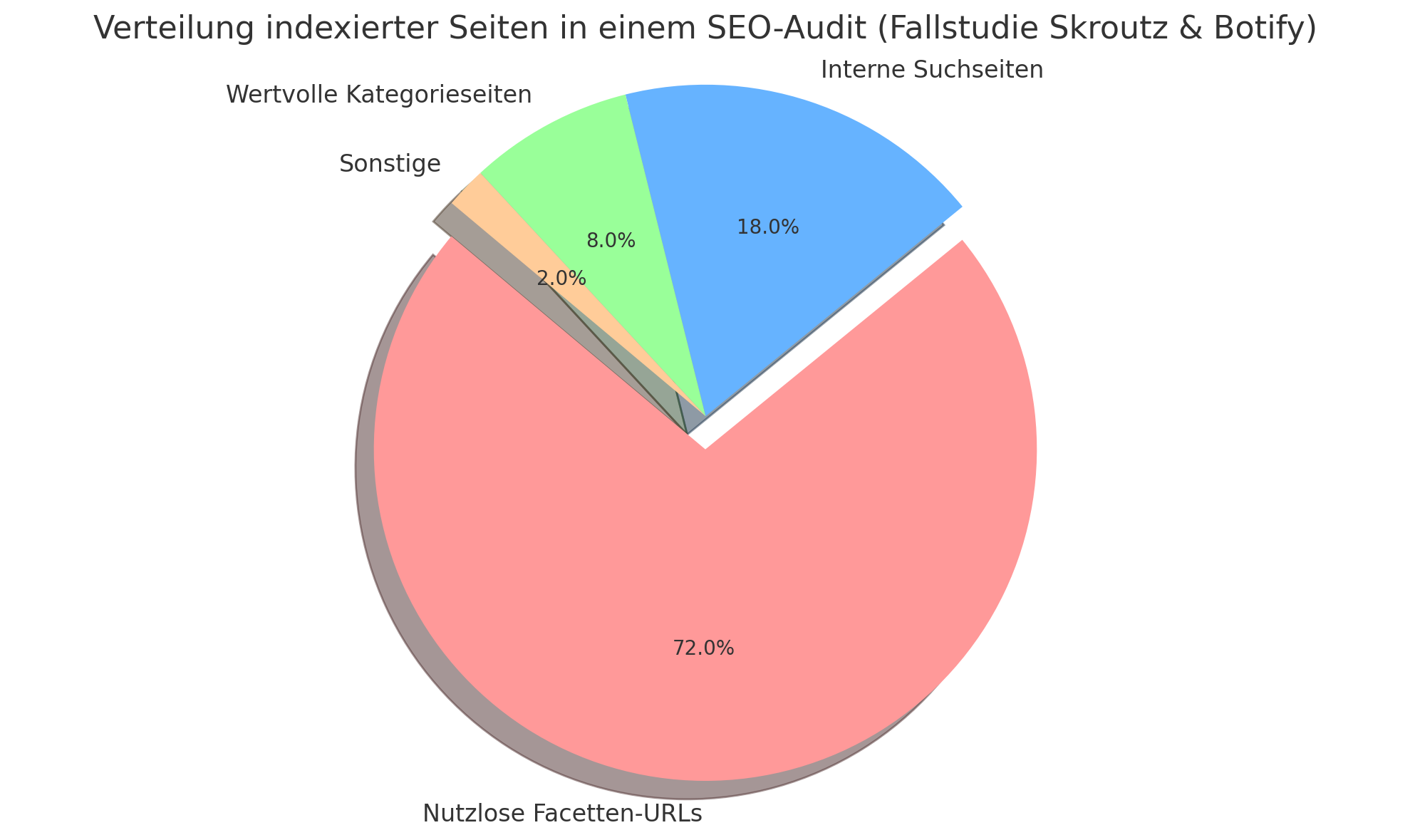

Eine eindrucksvolle Fallstudie von Skroutz & Botify zeigt, wie drastisch sich unkontrollierte Facettennavigation auf die Indexierung auswirken kann. In einem untersuchten Online-Shop machten über 70 % der indexierten Seiten nutzlose Facetten-URLs aus – also Seiten, die kaum oder keinen eigenständigen Mehrwert für Suchmaschinen oder Nutzer bieten. Das folgende Diagramm verdeutlicht, wie sich der Index einer E-Commerce-Seite ohne gezielte Steuerung zusammensetzen kann:

Hinweis: Dieses Verhältnis ist keine Ausnahme – viele große Shops kämpfen mit vergleichbaren Problemen durch nicht kontrollierte Facettennavigation.

Duplicate Content durch Filtervarianten

Facettennavigation erzeugt oft doppelten Inhalt, da viele Filterkombinationen letztlich ähnliche Produktlisten anzeigen. Beispielsweise kann dasselbe Sortiment an Schuhen unter /schuhe?farbe=rot und /schuhe?farbe=rot&größe=42 erreichbar sein. Suchmaschinen werten solche Seiten als eigenständige URLs – obwohl der Kerninhalt (Produktbeschreibung, Kategorien-Text) identisch ist. Offiziell führt Duplicate Content zwar nicht zu manuellen Abstrafungen, verwässert aber die Relevanz: Rankingsignale und Backlinks verteilen sich auf mehrere URLs statt auf eine konzentrierte. Zudem droht Keyword-Kannibalisierung, wenn mehrere Varianten um dieselben Suchbegriffe konkurrieren. Besonders Filterseiten, die sehr ähnliche oder keine eigenständigen Inhalte haben (z. B. lediglich sortiert nach Preis), können als wertarm eingestuft werden und die gesamte Domainqualität beeinträchtigen. Das Phänomen „Index Bloat“ überschneidet sich hier: Viele duplizierte Seiten ohne eigenen Mehrwert erschweren Google ein klares Bild der Website-Struktur.

Interne Verlinkung & PageRank-Verlust

Ein oft übersehener Aspekt: Interne Links in der Facettennavigation. Filtermenüs erzeugen zahlreiche Links (etwa zu jeder Farbkombination), die auf jeder Kategorieseite präsent sein können. Dadurch verteilt sich der interne PageRank auf unzählige Filter-URLs, anstatt die wichtigsten Seiten zu stärken. Diese Verdünnung der Linkpower schwächt u.U. die Rankings der Hauptkategorien und Produkte. Noch problematischer: Wenn geblockte Facettenseiten (z. B. via robots.txt) weiterhin intern verlinkt sind, crawlt Google sie trotz Blockade über eingehende Links – das Crawl-Budget wird trotzdem verbraucht und der Index mit „toten Seiten“ gefüllt. Falsch gesetzte interne Links (etwa facettierte URLs ohne Nutzen) stören also die SEO-Architektur und lenken sowohl Crawler als auch Nutzer vom Wesentlichen ab.

Technische Herausforderungen (URL-Parameter, Filter & Co.)

Die technische Umsetzung von Facettennavigation stellt SEO vor knifflige Aufgaben. Klassisch werden Filter über URL-Parameter realisiert (z. B. ?farbe=rot&marke=adidas); ohne besondere Vorkehrungen erzeugt jede Kombination eine einzigartige URL. Auch Sortierungen oder Paginierungen erzeugen weitere Varianten. Herausforderungen hierbei sind:

- Parameter-Steuerung: Das frühere URL-Parameter-Tool in der Google Search Console erlaubte es, Crawlern das Verhalten bei bestimmten Parametern vorzugeben – z. B.

sortieren=nicht indexieren. Google hat dieses Tool im April 2022 abgeschafft, weil es kaum genutzt wurde. Seither versucht die Suchmaschine, Parameter-Effekte automatisch zu erkennen. Für Website-Betreiber bedeutet das aber weniger direkte Kontrolle. - URL-Konsistenz: Unterschiedliche Reihenfolgen oder Schreibweisen von Parametern können jeweils neue URLs bedeuten. Wenn z. B.

/shirts?stil=casual&farbe=blauund/shirts?farbe=blau&stil=casualexistieren, vervielfacht sich die URL-Anzahl unnötig. Ohne feste URL-Struktur erzeugen unterschiedliche Filterreihenfolgen schnell eine Explosion an Kombinationen. - Technische Limits: Manche Shopsysteme erstellen für jede Filterausprägung statische Pfade (z. B.

/hosen/blau/), andere nutzen Hash-Fragmente (#filter=blau) oder rein JavaScript-gesteuerte Filter. Jede Methode hat Vor- und Nachteile: Hash-Fragmente ignoriert Google zwar beim Crawlen (somit keine Indexierung), sind aber nicht optimal für Barrierefreiheit und Sharing (wie Experten anmerken). Rein clientseitige Filter (AJAX) erzeugen keine URLs, können aber ohne zusätzliche Maßnahmen auch keine gezielten SEO-Landingpages bereitstellen. Die Balance zwischen SEO-Sichtbarkeit und technischer Sauberkeit ist hier schwierig.

Strategien zur SEO-Optimierung der Facettennavigation

Angesichts dieser Probleme ist eine strategische Herangehensweise nötig, um die Vorteile der Facettensuche zu nutzen, ohne die SEO-Performance zu gefährden. Im Kern geht es um Selektion und Kontrolle: Welche Facetten sollen suchmaschinenrelevant sein – und wie blockt man den Rest effizient? Folgende Leitfragen und Lösungen helfen bei der Optimierung:

Wann sollte eine Facettenseite indexiert werden (und wann nicht)?

Nicht jede Filterkombination verdient einen Platz im Google-Index. Als Faustregel gilt: Indexierbar sind Facettenseiten nur, wenn sie eigenständig Suchwert bieten. Das ist z. B. der Fall, wenn für die Facetten-Kombination relevantes Suchvolumen existiert oder Nutzer gezielt danach suchen (Stichwort Long-Tail-Keywords). Ein Online-Shop für Kleidung könnte etwa feststellen, dass viele Nutzer nach „Adidas Herren T-Shirt grau“ suchen – es lohnt sich, eine entsprechende gefilterte Seite indexierbar zu machen. Große Shops wie Zalando behandeln bestimmte Facetten deshalb wie eigene Landingpages (z. B. /t-shirts/adidas_grau/ für graue Adidas-T-Shirts), mit sprechenden URLs, eigenen H1-Titeln und Canonical Tags. Solche Seiten können in Google ranken und zusätzlichen Traffic bringen.

Andererseits gibt es unzählige Filterkombinationen ohne Suchnachfrage. Ein Nutzer mag fünf Filter gleichzeitig setzen, um das perfekte Produkt zu finden – aber kein Mensch sucht exakt nach dieser Kombination im Web. Diese Seiten sollten nicht indexiert werden. Denn sie würden nur „Indexbloat“ erzeugen und potentiell als Thin Content gelten (z. B. wenn kaum Produkte angezeigt werden). Studien zeigen, dass Millionen solcher Seiten die Domainqualität sogar negativ beeinflussen können. Die Kunst besteht also darin, wertvolle Facetten herauszufiltern:

- Analyse von Suchvolumen: Prüfen Sie, welche Filterbegriffe oder -kombinationen nennenswert gesucht werden (z. B. via Keyword-Tools). Beliebte Facetten können als eigenständige Seiten aufbereitet werden (mit eigenem SEO-Text, Meta-Description etc.). Wenig gefragte Filter können dagegen verborgen oder blockiert werden.

- Kategorisierung nach Ebene: Oft sind einzelne Filter (nur Farbe oder nur Marke) suchrelevant, während tiefe Kombinationen (Marke + Farbe + Größe + Feature) zu spezifisch sind. Man kann entscheiden, z. B. nur Einzelfilter indexierbar zu halten, aber Kombinationsfilter auf Noindex zu setzen.

- Dynamische vs. Statische Facettenseiten: Für wichtige Filter können statische, SEO-freundliche URLs angelegt werden (z. B. eigene Kategorie-Unterseiten für „Damen > Schuhe > Rot“). Diese lassen sich in die interne Verlinkung einbinden und mit unique Content versehen. Unwichtige Filter bleiben rein dynamisch (nur per AJAX, ohne eigene URL) oder erhalten einen

noindex.

Interne Verlinkung sinnvoll nutzen

Die interne Linkstruktur eines Shops sollte gewichtige Seiten priorisieren – also Kategorien, Topseller, relevante Landingpages. Facettenlinks im Filtermenü sind oft automatisch auf jeder Seite präsent und können schnell zur Linkfalle werden. Hier einige Strategien:

- Nicht indexierbare Facetten nicht verlinken: Filter, die per

robots.txtblockiert oder vianoindexausgesperrt werden, sollten idealerweise gar nicht als crawlbare Links im HTML stehen. Andernfalls finden Crawler sie dennoch und versuchen, sie aufzurufen. Lösungen sind etwa, solche Links mitrel="nofollow"zu versehen oder rein per JavaScript-Klick (ohne<a>-Link) zu implementieren. So verschwenden diese URLs kein Crawl-Budget und tauchen nicht in der internen Linkgrafik auf. - Wichtige Facettenseiten gezielt verlinken: Falls bestimmte Filterseiten indexierbar sein sollen, sollten sie auch aktiv unterstützt werden. Zum Beispiel kann eine kategorienahe Facette (z. B. „Herren > Schuhe > Schwarz“) von der Hauptkategorieseite per SEO-Textlink erreichbar sein. Kontextsensitive Verlinkung (etwa im Fließtext „Entdecken Sie auch unsere Auswahl an < href="/herren-schuhe/schwarz/">schwarzen Herrenschuhen“) verleiht diesen Seiten zusätzliches Gewicht.

- Breadcrumbs & Navigation prüfen: Bei manchen Shopsystemen erscheinen angewendete Filter als Teil der Breadcrumb-Navigation (z. B. Home > Schuhe > Herren >Filter: Schwarz).) – sicherzustellen ist, dass dabei keine ungewollten indexierbaren URLs generiert werden. Ggf. sollten Breadcrumb-Links zu gefilterten Zuständen vermieden oder auf kanonische URLs verweisen.

Durch kluge interne Verlinkung hält man den Link Juice bei den wichtigen Seiten und verhindert die von facettierten Links verursachte PageRank-Verdünnung.

Lösungen für Shops mit umfangreicher Filter-Navigation

Shops mit hunderten Filtern (z. B. große Marktplätze oder Sortimente mit vielen Attributen) brauchen klare Richtlinien, um der Filter-Flut Herr zu werden:

- Robuste Informationsarchitektur: Definieren Sie eine feste Hierarchie oder Logik, welche Filter kombiniert werden dürfen und wie URLs aufgebaut sind. Konsistente URL-Strukturen sind entscheidend: Legen Sie z. B. fest, dass stets die Reihenfolge Kategorie > Marke > Farbe genutzt wird. So vermeiden Sie doppelte URLs mit vertauschter Reihenfolge.

- Begrenzung der Kombinationsvielfalt: Überlegen Sie, gewisse Filter nur alleinstehend zuzulassen. Beispiel: Es könnten zwar Farbe oder Größe gefiltert werden, aber nicht beides gleichzeitig, wenn daraus kein Mehrwert entsteht. Jede zusätzliche Dimension erhöht die URL-Multiplikation exponentiell.

- AJAX & Load-More statt Paginated URLs: Wenn sehr viele Produkte zu laden sind, nutzen einige Shops „Load more“-Buttons oder unendliches Scrollen statt klassischer Pagination (z. B. ?page=2 etc.). Dies kann die Anzahl indexierbarer Seiten reduzieren – sofern keine HTML-Links für Folgeseiten generiert werden. Aber Vorsicht: Stellt sicher, dass Google zumindest den ersten Teil des Produktindex erfassen kann oder eine alternative Paginierung per Link vorhanden ist, um Linkjuice zu verteilen.

- Sonderfall Suchseiten: Oft bieten Shops neben Filtern auch eine Suche an. Interne Suchergebnisse sollten grundsätzlich mit

noindexversehen werden, um Duplicate Content zu vermeiden. Gleiches gilt für sehr fein granulare Filterkombinationen. - Monitoring & Feinsteuerung: Bei umfangreichen Facetten lohnt es sich, die Indexierungsstatistiken regelmäßig zu überwachen – etwa in der Google Search Console. Ein plötzlicher Anstieg an indexierten Filterseiten (z. B. „Gültig, aber nicht in Sitemap eingereicht“) kann auf Probleme hinweisen, die durch Nachjustieren von Disallow-Regeln oder Noindex-Tags behoben werden müssen.

Moderne technische Lösungen: Tools & Techniken

Die gute Nachricht: Es gibt bewährte technische Maßnahmen, um Facettennavigation SEO-freundlich zu gestalten. Meist ist eine Kombination aus Crawler-Steuerung und konsolidierenden Signalen erforderlich:

Crawling einschränken mit robots.txt

Die erste Verteidigungslinie gegen Crawl-Budget-Verschwendung ist die Datei robots.txt. Hier können Sie ganze URL-Muster vom Crawling ausschließen. Beispiel: Wenn Preisfilter nicht indexiert werden sollen, könnte man anweisen:

# Crawling von URL-Parametern "price" unterbinden

User-agent: *

Disallow: *?price=

Dieser Eintrag verbietet es Bots, jede URL mit ?price= aufzurufen. So werden solche Facetten gar nicht erst gecrawlt. Wichtig: robots.txt verhindert zwar das Crawlen, aber nicht das Indexieren. Wenn also irgendwo ein externer Link auf eine blockierte URL zeigt, kann Google die URL trotzdem indexieren – jedoch ohne Inhalt. Um dieses Restrisiko zu minimieren, sollten blockierte Facettenseiten idealerweise keine externen Links anziehen. Insgesamt ist robots.txt sehr effektiv zur Crawl-Steuerung und spart Ressourcen – Google empfiehlt diese Methode zur Optimierung des Crawl-Budgets bei Facettenseiten.

Canonical Tags zur Konsolidierung

Canonical Tags (<link rel="canonical" href="...">) sind ein zentrales Instrument gegen Duplicate Content. Auf Facettenseiten eingesetzt, können sie alle Varianten auf eine Hauptseite konsolidieren. Typischerweise wird der Canonical einer gefilterten Seite auf die ungefilterte Kategorie gesetzt. Beispiel: /schuhe?farbe=rot enthält im <head>:

<link rel="canonical" href="https://www.beispielshop.de/schuhe/" />

Damit signalisiert die gefilterte Seite, dass die kanonische Version die Hauptkategorieseite ist. Suchmaschinen sollten primär diese indexieren. Vorteil: Der Linkjuice aller Filter-URLs fließt der kanonischen Seite zu, Duplicate Content wird zusammengeführt. Nachteil: Canonicals sind ein Hinweis – keine Direktive. Google benötigt oft Zeit, um sie umzusetzen; bereits indexierte Facetten verschwinden nicht sofort. Für neue Filterseiten oder den Launch einer neuen Navigation sind Canonicals ideal, um von Beginn an Ordnung zu halten.

Tipp: Verwenden Sie Canonical Tags konsequent auf allen facettierten Seiten – selbst wenn Sie zusätzliche Maßnahmen ergreifen. Sie dienen als Rückfallebene, falls andere Methoden versagen. Beachten Sie, Canonicals innerhalb derselben Sprach-/Länderversion zu verwenden. Für internationale Shops sollten zusätzlich Hreflang-Links gesetzt werden (wie im Zalando-Beispiel, wo jede Facetten-URL hreflang-Alternates für andere Länder besitzt).

Noindex-Meta & X-Robots

Eine direktere Methode ist der Meta-Robots-Tag mit content="noindex". Eingebunden im <head> einer Seite, z. B.:

<meta name="robots" content="noindex, follow" />

Dies weist Google an, die Seite nicht in den Index aufzunehmen. Für Filterseiten, die zwar gecrawlt werden dürfen (um z. B. dem Canonical zu folgen), aber nicht ranken sollen, ist dies sinnvoll. Ein Anwendungsfall: Ein Shop möchte die Seite für „graue T-Shirts“ indexieren, aber nicht dieselbe Seite mit zusätzlich gesetztem Preisfilter. Die Variante mit Preis erhält also ein Noindex. Wichtig: Noindex hält Crawler nicht fern – die Seite wird weiterhin besucht und verbraucht so etwas Crawl-Budget. Daher ist Noindex oft in Kombination mit anderen Lösungen sinnvoll: Man lässt Crawler ran (vielleicht, um den Canonical zu sehen), schließt jedoch die Indexierung aus. Über den X-Robots-Tag im HTTP-Header kann Noindex zudem serverseitig für bestimmte URL-Muster gesendet werden (nützlich bei Parametern ohne individuelle Seiten-Templates).

URL-Parametersteuerung (Google Search Console)

Historisch gab es in der Search Console ein Tool, um das Verhalten von Googlebot bei bestimmten Parametern zu konfigurieren (z. B. page ignorieren, filter nur eine Variante crawlen). Dieses URL-Parameter-Tool wurde 2022 deaktiviert. Google begründete den Schritt damit, dass es nur selten gebraucht wurde und Crawler inzwischen automatisiert smarter sind. Aktuell bleibt Webmastern nur, Parameter über Maßnahmen wie robots.txt, Canonical oder Noindex zu steuern. Eine saubere interne Verlinkung und Sitemaps, die nur relevante URLs enthalten, helfen Google, die wichtigen Inhalte zu erkennen. Falls Google dennoch unnötige Parameter indexiert, müssen zusätzliche Disallow-Regeln oder Links entfernt werden. In Zukunft könnten erweiterte Controls zurückkehren – Google diskutiert, wie man besser mit URL-Parametern umgehen kann, um endlose URL-Räume einzudämmen.

AJAX & JavaScript-Filter als SEO-Lösung

Eine radikale, aber effektive Lösung ist, Facetten vollständig clientseitig umzusetzen. Anstatt jeden Filter in der URL abzubilden, bleiben Nutzerinteraktionen auf derselben URL, während das Produktlisting per AJAX neu geladen wird. Vorteile:

- Keine neuen URLs: Da die Seite nicht neu lädt und die URL gleich bleibt, entstehen keine zusätzlichen indexierbaren Filter-Seiten. Damit umgeht man Duplicate Content und Crawl-Budget-Probleme vollständig.

Geschwindigkeit & User Experience: AJAX-Filterung kann schneller wirken, da nur Daten nachgeladen werden. Nutzer können mehrere Filter setzen und dann z. B. auf „Anwenden“ klicken, was gerade auf mobilen Geräten eine bessere UX bietet.

Nachteile sollten jedoch bedacht werden: Reine AJAX-Lösungen sind unsichtbar für Suchmaschinen – Google kann Inhalte, die erst nach einem Filterklick geladen werden, nicht erfassen. Dies ist in Ordnung, wenn diese Inhalte nicht indexiert werden sollen, birgt jedoch das Risiko, dass potenzielle Landingpages für spezifische Suchanfragen ungenutzt bleiben. Ein Kompromiss ist der Einsatz hybrider Lösungen: Wichtige Filterseiten werden als HTML bereitgestellt, während irrelevante Filter per AJAX gehandhabt werden. Technisch lassen sich AJAX-Filter so implementieren, dass sie mittels History API (PushState) die URL aktualisieren, wodurch bestimmte Filterzustände teilindexierbar werden. Allerdings muss hierbei auf die bekannten SEO-Regeln geachtet werden.

Eine clevere Variante ist die Nutzung von URL-Hashes (# in der URL), um Filterzustände darzustellen. Alles nach dem # wird von Browsern verarbeitet, aber von Google in der Regel ignoriert. Beispielsweise könnte /kategorie/x die Basis sein und Filter nur als Fragment anhängen (/kategorie/x#farbe=rot&groesse=L). Google sieht und indexiert nur /kategorie/x. Dies verhindert automatisch das Crawling und die Indexierung der Filterzustände. Allerdings sind Hash-Lösungen aus UX-Sicht nicht optimal, da kein Seiten-Neuladen erfolgt, was direkte Links auf eine gefilterte Ansicht erschwert. Zudem sind sie schlecht für Barrierefreiheit und Social-Media-Previews. Daher setzen viele moderne Shops auf serverseitige oder History-API-Lösungen anstelle klassischer Hash-Navigation.

Zusammengefasst sollte die Entscheidung für AJAX/JS abwägen, welche Facetten man bewusst nicht für SEO nutzen will. Für alle anderen Fälle gilt: Besser sauber indexierbare URLs mit entsprechenden Canonicals/Noindex versehen, als darauf zu hoffen, dass Google bestimmte Inhalte ignoriert.

Code-Beispiele: Fehlerhafte vs. optimierte Implementierung

Zum Abschluss zwei einfache Code-Beispiele, die einen falschen und einen optimierten Umgang mit Facettennavigation illustrieren.

1. Fehlerhaftes Beispiel (SEO-Probleme durch falsche URL-Parameter):

Angenommen, ein Online-Shop für Elektronik lässt Nutzer nach Verfügbarkeit und Bewertung filtern. Eine naive Implementierung könnte so aussehen:

<link rel="canonical" href="https://www.beispielshop.de/fernseher/" />

In diesem Beispiel erzeugt jeder Klick auf einen Filter einen direkten Link mit Parametern (?verfuegbar=true&bewertung=5sterne). Problematisch ist hier:

- Indexierung: Ohne Gegenmaßnahmen würde

/fernseher?verfuegbar=true&bewertung=5sterneindexierbar sein. Ähnliche Links für 4★, 3★ etc. multiplizieren sich und führen zu Duplicate Content. - Keine Konsolidierung: Es gibt keinen

<link rel="canonical">im Seitenkopf, der auf/fernseherverweist. Suchmaschinen werten diese URL als eigenständige Seite, was zu Kannibalisierung führen kann. - Interne Verlinkung: Da der Link im HTML steht, crawlt Google ihn garantiert (sofern nicht

nofollowgesetzt ist). Dies verschwendet Crawl-Budget, da Verfügbarkeits- und Bewertungsfilter keine eigenständigen Suchziele sind.

Weitere Aspekte fehlen im Fehlerbeispiel: Zum Beispiel ein noindex-Tag auf der Ergebnisseite, um sie aus dem Index fernzuhalten, oder eine robots.txt-Regel zum Ausschluss solcher Parameter. Im schlimmsten Fall könnten Hunderte dieser URL-Varianten indexiert werden – jede mit minimalem Unterschied, aber gleichem Seitentext.

2. Optimierte Variante (Lösungen mit Canonical & Noindex):

Im optimierten Beispiel fangen wir die Probleme ab. Die verfügbare 5★-Filterseite erhält im <head> passende Meta-Tags:

<link rel="canonical" href="https://www.beispielshop.de/fernseher/" />

<meta name="robots" content="noindex, follow" />

Und in der robots.txt des Shops stellen wir sicher, dass solche Filter-URLs gar nicht erst gecrawlt werden:

User-agent: *

Disallow: /*?verfuegbar=

Erläuterung: Die Canonical-URL zeigt auf die übergeordnete Kategorie ohne Filter (/fernseher/), sodass Google alle Filtervarianten dieser Kategorie bündelt. Der Meta-Robots-Tag noindex verhindert, dass diese spezielle Kombination in den Index aufgenommen wird – selbst wenn sie temporär gecrawlt wurde. In der robots.txt wurden alle URLs mit dem Parameter verfuegbar ausgeschlossen, um das Crawl-Budget zu schonen.

Da diese Maßnahmen greifen, kann der Filter-Link für Nutzer bestehen bleiben, da er hilfreich ist – Google schenkt ihm jedoch kaum Beachtung. Alternativ könnte man den Link auch per JavaScript umstellen oder rel="nofollow" hinzufügen, um ganz sicherzugehen.

Hinweis: In manchen Fällen möchte man statt Noindex eher Index, follow setzen, falls Filterseiten zwar indexiert, aber per Canonical auf die Hauptseite verwiesen werden sollen. Im Zweifel ist das obige Setup – Canonical und Noindex – jedoch eine sehr sichere Variante: Die Seite taucht nicht in den Suchergebnissen auf, und der Linkjuice fließt an die Hauptseite.

Best Practices für verschiedene Shop-Systeme

Jede Shop-Plattform bringt Eigenheiten mit, wie sie Facetten/Filter strukturiert. Einige Tipps für gängige Systeme:

Magento (Adobe Commerce)

Magento nutzt „Layered Navigation“ für Filter auf Kategorieseiten. Standardmäßig entstehen hier viele Parameter-URLs, die kanalisiert werden müssen. Stellen Sie sicher, dass Canonical-Links von gefilterten Seiten auf die Kategorie verweisen (Magento 2 bietet hierfür Einstellungen im Backend oder erfordert ein SEO-Plugin). Viele Magento-Shops fügen zusätzlich einen Meta-noindex auf Filterergebnisse ein oder nutzen Extensions, die Filter via AJAX laden. Da Magento inhaltsstarke Seiten begünstigt, sollten auch Filter-Texte (beschreibende Texte über der Produktliste) eingesetzt werden, wenn bestimmte Facetten indexiert werden sollen – um Duplicate Content zu reduzieren. Eine bekannte Technik ist die PRG-Pattern-Implementierung (Post-Redirect-Get): Filteranfragen werden per POST gesendet und dann auf eine saubere URL weitergeleitet, sodass keine parametrisierte URL zurückbleibt. Kurz gesagt: Canonical Tags sind Pflicht in Magento, ergänzt durch robots.txt-Regeln für unnötige Parameter wie Preis oder Sortierung.

Shopify

Shopify’s Kernsystem generiert Kategorieseiten (Collections) und erlaubt Filter meist über Tags oder URL-Parameter. Out-of-the-box kann es passieren, dass gefilterte Collection-Seiten einen Self-Canonical besitzen (also auf sich selbst zeigen) und somit als eigenständige Seiten gelten. Die Folge sind ähnliche Seiten mit Duplicate Content, die zwar nicht zusammengeführt werden, aber auch nicht noindex sind – SEO-technisch ungünstig. Abhilfe schafft ein kleiner Code-Snippet im Theme, der den Canonical immer auf die ungefilterte Collection zeigt. Zusätzlich kann man mittels Liquid-Template-Logik <meta name="robots" content="noindex"> einfügen, wenn bestimmte Filter-Parameter in der URL vorhanden sind. Da man bei Shopify keinen direkten Serverzugriff auf die robots.txt hat (diese wird automatisch generiert), müssen viele Anpassungen über solche Liquid-Tweaks und ggf. Googlebot Meta-Tags erfolgen. Positiv ist, dass viele neuere Shopify-Themes Filter via AJAX nachladen – hier sollte sichergestellt werden, dass keine extra URL erzeugt wird oder die History-State-URL per Canonical abgefangen wird. Prüfen Sie außerdem die Shopify-eigene Einstellung zur Indizierung von Tag-Seiten: Teilweise können /collections/xyz/tag/abc-Seiten entstehen, die auf "hidden" gestellt oder per noindex aus der Suche gehalten werden sollten.

WooCommerce (WordPress)

WooCommerce erzeugt Filter meist über Query-Parameter (z. B. ?filter_color=rot). Anders als Magento oder Shopify gibt es hier kaum automatische Lösungen zur Bewältigung der SEO-Probleme. Es empfiehlt sich, ein SEO-Plugin wie Yoast oder RankMath zu nutzen, das Filter-URLs erkennt und mit noindex versieht. Oft werden Filter als Widget in Seitenleisten eingesetzt – achten Sie darauf, dass in den Seitentemplates nofollow für Filterlinks genutzt wird, sofern diese indexiert werden könnten. Eine populäre Lösung in WooCommerce ist der komplette Einsatz von AJAX-basierten Filter-Plugins, die die Produktliste dynamisch aktualisieren, ohne die URL zu ändern. Damit vermeidet man die Indexierung. Wer programmatische Kontrolle hat, kann einen Hook verwenden, um beim Rendern einer gefilterten Produktkategorie via PHP einen <meta name="robots" content="noindex"> auszugeben. Ein Trick ist, anhand der URL (z. B. is_product_category() und das Vorhandensein von $_GET-Parametern) zu entscheiden, ob Noindex gesendet wird. Wichtig: WooCommerce-Standardfunktionen wie „Shop nach Preis filtern“ erzeugen oft seiteninterne Links – diese sollten in die robots.txt-Disallow aufgenommen werden (z. B. Disallow: /*?filter_*), um Google daran zu hindern, wild durch das Sortiment zu springen.

Fazit

Eine umfangreiche Facettennavigation im Online-Shop muss kein SEO-Albtraum sein – sofern die richtigen Optimierungen vorgenommen werden. Die größten Probleme liegen bei Crawling und doppeltem Content: Unkontrollierte Filter erzeugen Unmengen an URLs, die weder für Nutzer noch Suchmaschinen einen Mehrwert bieten. Daher ist Kontrolle besser als Zufall: Definieren Sie klar, welche Facetten indexiert werden dürfen, und blocken Sie den Rest konsequent (mittels robots.txt, Canonical oder Noindex). Achten Sie darauf, interne Links so zu gestalten, dass keine Crawl-Schleifen entstehen. Moderne SEO-Tools bieten zahlreiche Hebel – vom simplen Disallow-Eintrag bis zur ausgefeilten AJAX-Navigation. Entscheidend ist, dass Technik und Strategie zusammenspielen: Ein Shop kann nutzerfreundliche Filter anbieten und dennoch SEO-clean bleiben. Im Zweifel gilt: Weniger ist mehr. Lieber einige wenige, optimierte Facettenseiten mit einzigartigem Inhalt anbieten, als jede erdenkliche Kombination Google zu präsentieren. Mit den hier vorgestellten Strategien und Best Practices bleibt Ihre Facettennavigation nützlich für Kunden und unschädlich für Ihr SEO – im Idealfall wird sie sogar zum SEO-Vorteil, indem sie Long-Tail-Traffic über spezialisierte Landingpages anzieht.